Балка на: LED балки на авто на автомобиль купить в Москве

Содержание

Светодиодная балка на 120 Batt Combo (ближний / дальний)

В последнее время самый частый вопрос от наших клиентов звучит примерно так:

– Я хочу купить фаркоп, защитную дугу и пороги вашего производства, нужно ли их вносить как изменения в конструкцию транспортного средства и что мне будет, если меня остановят сотрудники ГИБДД?

Давайте попробуем разобраться нужно или нет?

Единственным документом, подтверждающим соответствие автомобиля требованиям технического регламента Таможенного союза (ТР ТС 018/2011) «О безопасности колесных транспортных средств», принятого Решением Комиссии Таможенного союза от 09.12.2011 г. № 877 (с изменениями) является «Одобрение Типа Транспортного Средства» (далее – ОТТС).

После прохождения всех испытаний и проверок на соответствие требований ТР ТС 018/2011, аккредитованным органом сертификации оформляется ОТТС на определённую марку и модель, данный документ выдается на определённую партию транспортных средств с указанием номеров VIN (**********001 — **************999) и в нем перечислено всё оборудование, одобренное к установке (если не установлено при продаже заводом-изготовителем) и использованию на дорогах общего пользования без оформления внесений изменений в конструкцию транспортного средства. Проще говоря: все то, что вписано в конкретное ОТТС – уже разрешено к эксплуатации на данной партии автомобилей.

Проще говоря: все то, что вписано в конкретное ОТТС – уже разрешено к эксплуатации на данной партии автомобилей.

Пример: автомобиль Pajero Sport III 2019 года выпуска

На странице №6 в приложении находим интересующий перечень одобренного оборудования для данного типа транспортного средства:

Исходя из сведений, указанных в документах выше, автомобиль (входящий в партию, включенных в ОТТС) может использоваться с фаркопом (ТСУ), боковыми подножками, нижними защитами переднего и заднего бамперов. Естественно, что в ОТТС не указан производитель данных конструкций и он может быть любым: главное условие – наличие сертификата/декларации соответствия на выпускаемую продукцию либо наличие документа, подтверждающего отсутствие необходимости оформления сертификата/декларации соответствия.

И вот теперь, задаётся вопрос: где получить сертификат соответствия на купленные в «Pajero Shop» фаркоп, дугу, пороги? Отвечаем: у нас нет сертификата соответствия на продукцию, потому что мы не выпускаем ее серийно, о чем сказано в официально оформленном заключении «ВНИИС»:

Что такое заключение «ВНИИС»? – Ответ поставщику или производителю продукции о том, подлежит ли продукция обязательной сертификации или декларированию, также именуется «отказное письмо». Данный документ оформляется с учетом требований нормативных документов в рамках действующих технических регламентов Таможенного союза, и свидетельствует о том, что указанная в нём продукция не подлежит обязательному подтверждению соответствия.

Данный документ оформляется с учетом требований нормативных документов в рамках действующих технических регламентов Таможенного союза, и свидетельствует о том, что указанная в нём продукция не подлежит обязательному подтверждению соответствия.

Что такое «ВНИИС»? – Всероссийский научно-исследовательский институт сертификации, который как раз и определяет: нужен ли на продукцию сертификат/декларация?

Выводы: чтобы понять, нужно ли Вам вносить изменения в конструкцию транспортного средства на купленные фаркоп, защитную дугу и пороги, требуется:

– посмотреть, что разрешено ставить на Ваш автомобиль;

– скачать ОТТС от Вашего автомобиля и заключение «ВНИИС» (отказное письмо);

– распечатать ОТТС и заключение «ВНИИС»;

– положить в бардачок Вашего автомобиля и общаться с сотрудником ГИБДД языком документов, а не словами: мне чета там показалось 🤣

ПыСы: если Вас не устраивает наше Отказное письмо, то Вы можете скачать любой сертификат на Яндекс. Картинках и возить его с собой 😉

Картинках и возить его с собой 😉

Детальная памятка о том, как общаться с органами ГИБДД

(первоисточник)

Сколько стоит балка на ГАЗель 3302-3001010-01, 3302-3001010 – цена от Автохис

Характеристики товара:

| Каталожный номер: | 3302-3001010-01, 3302-3001010 |

| Марка авто | ГАЗ |

| Модель авто | Газель |

| Тип техники | Легковой |

| Страна производства | Россия (РФ) |

| Производитель запчасти | Автохис |

| Вес: | 0 кг. |

| Гарантия: | 6 месяцев |

Краткое описание:

Балка подвески передней ГАЗ-3302 3302-3001010-01

Отзывы и оценки покупателей:

Оценка расчитывется, как средняя из всех оценок покупателей за все время

Вы можете оставить свой отзыв на сайте:

Антон Черкесск

16 марта 2017

Автохис

г. Нижний Новгород, ул.Ракетная, 9б

Нижний Новгород, ул.Ракетная, 9б

603108

8 (831) 262-11-79

[email protected]

Заказывал балку, доставили в срок. Индивидуальный подход к клиентам. Сотрудники ООО «АВТОХИС» — являются профессионалами своего дела, качественно и грамотно выполняющими заказ. Продолжу сотрудничать. Спасибо

ПОДБЕРЕМ и ОТПРАВИМ транспортной компанией с учетом приемлемых для вас сроков и стоимости доставки

БЕСПЛАТНО ДОВЕЗЕМ запчасть до терминала (вне зависимости от ее веса и стоимости), вы оплатите только услуги доставки транспортной компании

Доставка осуществляется логистическими компаниями:

Деловые линии

ПЭК

Кит

Энергия

Байкал Сервис

CDEK

ЖелдорЭкспедиция

Благодаря наличию складов в Москве и Санкт-Петербурге для этих городов, а также Владимира и Ульяновска существуют варианты бесплатной доставки в короткие сроки. Запчасти доставляются каждую неделю.

Запчасти доставляются каждую неделю.

Мы всегда стараемся держать актуальные цены на сайте, но все же иногда они могут отличаться от фактических. Пожалуйста, уточняйте точную стоимость у менеджера.

Информация для физических лиц

Какими способами я могу оплатить заказанную автозапчасть?

- Безналичный расчет.

- При отсутствии возможности перевести средства с расчетного счета, наша организация выставляет счет физическому лицу, который он может оплатить в любом банке.

Когда я могу произвести оплату?

- Полная оплата стоимости при покупке. ОБРАТИТЕ ВНИМАНИЕ! В этом случае заказ отправляется любой транспортной компанией.

- Частичная предоплата. Оплачивается часть стоимости товара, остаток суммы – после поступления агрегата на терминал транспортной компании в вашем городе. ОБРАТИТЕ ВНИМАНИЕ! В этом случае заказ отправляется исключительно «Деловыми линиями».

ВАЖНО! При полной и частичной оплате мы вышлем вам на почту копию оформленной товарной накладной, заверенную печатью, с указанием наименования товара, его стоимости. Оригинал накладной придет вместе с товаром.

Оригинал накладной придет вместе с товаром.

Информация для юридических лиц

Товар оплачивается по безналичному расчету.

Как получить счет?

Вы присылаете нам реквизиты фирмы на электронную почту, мы выставляем счет и составляем договор. Договор подписывается с обеих сторон и после этого клиент оплачивает счет.

Как оплатить счет?

Оплата банковским переводом на расчетный счет компании по реквизитам, указанным в выставленном счете. Все бухгалтерские документы отправляются вместе с товаром. Возможна отсрочка платежа (по согласованию с руководством).

На все товары в нашем интернет-магазине действует расширенная гарантия 6 месяцев или 15 тысяч км (на электронику действует расширенная гарантия 3 месяцев). Гарантийный талон отправляется покупателю вместе с запчастью.

Что она в себя включает:

Гарантийная замена запчасти в случае брака в течение 6 месяцев

В случае обнаружения производственного брака, вы можете обменять деталь по гарантии в течение полугода после покупки (до 15 тысяч км пробега).

Для этого:

- Необходимо отправить деталь нам обратно.

- Сразу после получения автозапчасти нами проводится дефектовка товара (3-10 дней).

- Если дефектовка подтверждает производственный брак, то отправляем вам новую запчасть. Транспортные расходы на отправку замененной детали до вас берет на себя наша фирма.

- Если же дефектовка показывает, что запчасть была повреждена в результате неправильной эксплуатации, мы можем ее отремонтировать с вашего согласия за ваш счет. В случае отказа от ремонта мы отправим деталь вам обратно. В данном случае транспортные расходы на отправку детали ложатся на вас.

ремонт запчасти

В случае обнаружения неисправности, вы можете отремонтировать деталь в нашей компании.

Для этого:

- Отправьте деталь нам обратно.

- Сразу после получения автозапчасти нами проводится дефектовка товара (3-10 дней).

- После дефектовки мы можем отремонтировать запчасть по нашему прейскуранту с вашего согласия.

В случае отказа от ремонта мы отправим деталь вам обратно. В данном случае транспортные расходы на отправку детали ложатся на вас.

В случае отказа от ремонта мы отправим деталь вам обратно. В данном случае транспортные расходы на отправку детали ложатся на вас.

Сроки и условия гарантии

Оставьте заявку через форму обратной связи, или позвоните по бесплатному номеру

Получите консультацию специалиста, обговорите детали заказа

Выберите подходящий для вас способ доставки (по телефону)

Выберите удобный способ оплаты и подтвердите заказ (по телефону)

Сервис нашего магазина позволяет делать заказ очень быстро и просто!

1. Консультация и подбор товара

В случае, если вы точно не знаете, какая автозапчасть нужна, вы можете получить консультацию нашего специалиста по телефону. Для этого оставьте заявку на бесплатную консультацию по кнопке в шапке сайта (специалист перезвонит вам в течение нескольких минут), кроме этого вы можете позвонить по номеру, указанному в шапке сайта.

2. Оформление и подтверждение заказа

Перейдя на карточку выбранного товара, вы можете оформить заказ, нажав кнопку «купить». Оформление заказа подразумевает заполнение полей: имя, номер мобильного телефона. Для быстрого заказа Вы можете воспользоваться формой обратного звонка, кликнув на красный круг с телефонной трубкой и введя свой номер телефона.

Оформление заказа подразумевает заполнение полей: имя, номер мобильного телефона. Для быстрого заказа Вы можете воспользоваться формой обратного звонка, кликнув на красный круг с телефонной трубкой и введя свой номер телефона.

Внимание! Неправильно указанный номер телефона, неточный или неполный адрес могут привести к задержке! Пожалуйста, внимательно проверяйте ваши персональные данные при оформлении заказа.

В течение часа после оформления заказа с Вами свяжется наш менеджер для согласования заказа, сроков, способа и места доставки.

Балка на ГАЗель

При использовании грузовых автомобилей в плохих дорожных условиях наиболее уязвимыми для получения повреждений являются комплектующие ходовой части. Подвеска принимает на себя всю нагрузку от попадания колес в выбоины и «прыжков» через неровности покрытия.

В передней оси основное усилие ложится на балку – базовый элемент, призванный обеспечить прочность всей конструкции. Выход этой детали из строя грозит полным разрушением подвески, поэтому своевременная замена способна предотвратить серьезные неприятности для владельца машины.

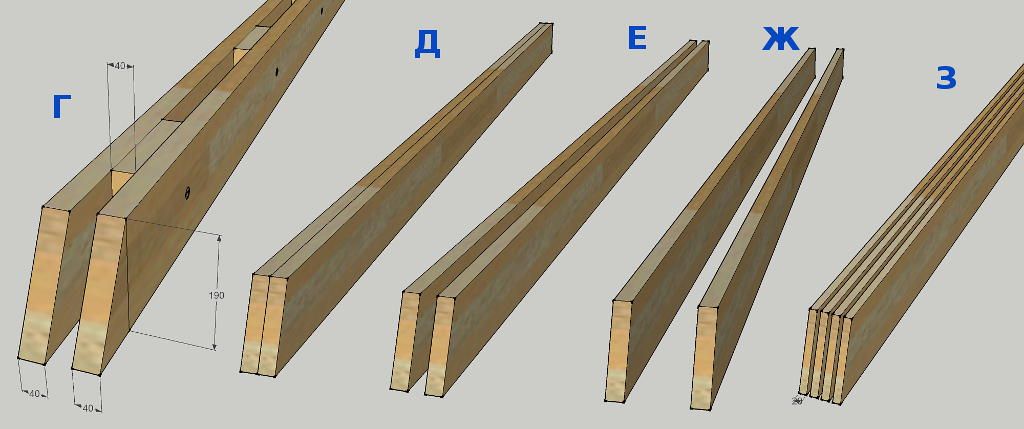

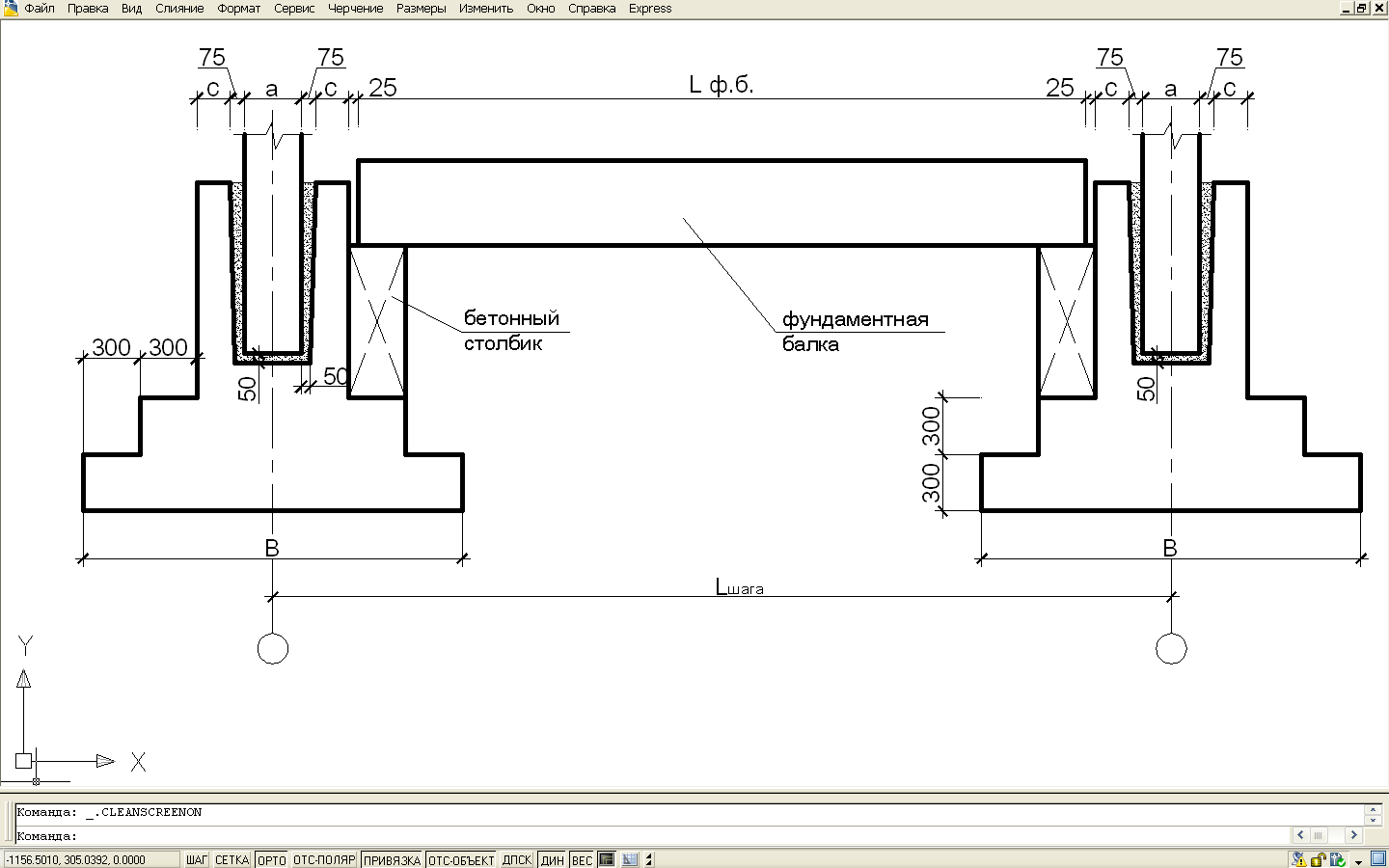

Балка на ГАЗель: устройство

В автомобилях ГАЗ 3302 и 2705 используется унифицированная штампованная балка двутаврового сечения, соединяемая с поворотными кулачками при помощи специальных шкворней. Конструктивно она представляет собой монолитную металлическую деталь с отверстиями, необходимыми для закрепления других узлов, и проточками для движения масла.

Основная функция балки – равномерное распределение нагрузки, передаваемой амортизаторами, рессорами и колесной базой через подшипники поворотных кулаков.

Сколько стоит передняя балка на газель?

Цена передней балки напрямую зависит от качества самой детали. Стоимость низкопробных аналогов существенно ниже, чем у оригинальных запчастей заводского производителя, однако предел прочности и эксплуатационная надежность таких деталей также находятся на невысоком уровне.

Интернет-магазин «Автохис» предлагает своим клиентам оригинальные комплектующие для автомобилей российского производства. Наличие прямых поставок от производителей позволяет нам формировать выгодную для покупателя ценовую политику без различных торгово-посреднических наценок. Широкий ассортимент фирменных запасных частей обеспечивает возможность удовлетворить любые запросы по ремонту автомобилей.

Широкий ассортимент фирменных запасных частей обеспечивает возможность удовлетворить любые запросы по ремонту автомобилей.

Чтобы уточнить, сколько стоит балка на ГАЗель и другие комплектующие для автомобилей производства Горьковского автозавода, заполните форму заказа на нашем сайте или воспользуйтесь услугой обратного звонка.

Калькулятор коэффициента площади

Более мощная онлайн-версия нашего популярного мобильного приложения.

Выберите форму

Выберите толщину фольги

| Укажите единицы измерения | ММ | МИЛС |

|---|

Укажите диаметр

Толщина выбрана

| Соотношение сторон | ||

|---|---|---|

| Объем в кубических милах | ||

| *Предлагаемый тип порошка |

| Укажите единицы измерения | ММ | МИЛС |

|---|

Укажите размер

Толщина выбрана

| Коэффициент сжатия | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

90 020 Отношение площадей

| Укажите единицы измерения | ММ | МИЛС |

|---|

Укажите размер

Толщина Выбрано

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

Соотношение площадей

900 08

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | ММ | МИЛС |

|---|

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | ММ | МИЛ |

|---|

Укажите диаметр

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| * Рекомендуемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | ММ | МИЛ |

|---|

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Рекомендуемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | ММ | МИЛ |

|---|

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | ММ | МИЛ |

|---|

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Предлагаемый тип порошка |

Соотношение площадей

| Укажите единицы измерения | мм | МИЛ |

|---|

Укажите размер

Выбранная толщина

| Соотношение сторон | |

|---|---|

| Объем в кубических милах | |

| *Рекомендуемый тип порошка |

Соотношение площадей

* Тип порошка основан на наименьшем указанном размере апертуры.

Apache Spark Runner

Apache Spark Runner можно использовать для выполнения конвейеров Beam с помощью Apache Spark.

Spark Runner может выполнять конвейеры Spark так же, как собственное приложение Spark; развертывание автономного приложения для локального режима, работающего на Spark Standalone RM или с использованием YARN или Mesos.

Spark Runner выполняет конвейеры Beam поверх Apache Spark, предоставляя:

- Пакетные и потоковые (и комбинированные) конвейеры.

- Те же гарантии отказоустойчивости, что и для RDD и DStreams.

- Те же функции безопасности, что и Spark.

- Встроенная отчетность по метрикам с использованием системы метрик Spark, которая также сообщает об агрегаторах Beam.

- Встроенная поддержка боковых входов Beam через переменные вещания spark.

Матрица возможностей луча документирует поддерживаемые в настоящее время возможности Spark Runner.

Три разновидности Spark runner

Spark runner выпускается в трех вариантах:

- Унаследованный Runner , который поддерживает только Java (и другие языки на основе JVM) и основан на Spark RDD/DStream

- An Структурированная потоковая передача Spark Runner , которая поддерживает только Java (и другие языки на основе JVM) и основана на наборах данных Spark и инфраструктуре структурированной потоковой передачи Apache Spark.

Примечание: Он все еще является экспериментальным, охват модели Beam является частичным. На данный момент он поддерживает только пакетный режим.

- Портативный Runner с поддержкой Java, Python и Go

портативная функциональность Spark Runner. Пожалуйста, используйте переключатель ниже, чтобы

выберите соответствующий бегунок:

Какой бегунок использовать: переносной или непереносной?

Beam и его Runners изначально поддерживали только языки на основе JVM

(например, Java/Scala/Kotlin). Позднее были добавлены Python и Go SDK.

Позднее были добавлены Python и Go SDK.

Архитектура Runners должна была быть значительно изменена, чтобы поддерживать выполнение

конвейеры, написанные на других языках.

Если ваши приложения используют только Java, то в настоящее время вам следует использовать один из бегунов на основе Java.

Если вы хотите запускать конвейеры Python или Go с Beam на Spark, вам нужно использовать

портативный бегун. Дополнительную информацию о переносимости см.

Страница переносимости.

Предварительные требования и настройка Spark Runner

Spark Runner в настоящее время поддерживает ветку Spark 3.1.x.

Примечание. Поддержка Spark 2.4.x устарела, начиная с Beam 2.41.0, и окончательно прекращена с выпуском Beam 2.46.0.

Вы можете добавить зависимость от последней версии Spark runner, добавив в свой pom.xml следующее:

org.apache.beam beam-runners-spark-3 <версия>2.47.0

Развертывание Spark с вашим приложением

В некоторых случаях, например, при работе в локальном/автономном режиме, вашему (автономному) приложению потребуется упаковать Spark, явно добавив следующие зависимости в ваш pom.xml :

<зависимость>org.apache.spark spark-core_2.12 <версия>${spark.version} <зависимость>org.apache.spark spark-streaming_2.12 <версия>${spark.version}

И затенение jar приложения с помощью плагина maven shadow:

org.apache.maven.plugins плагин maven-shade <конфигурация>false <фильтры> <фильтр> <артефакт>*:* <исключает>META-INF/*.SF META-INF/*. DSA

META-INF/*.RSA <выполнения> <исполнение> <фаза>пакет <цели>оттенок <конфигурация>true затененный <трансформеры> <трансформер реализация = "org.apache.maven.plugins.shade.resource.ServicesResourceTransformer"/>

После запуска mvn package запустите ls target , и вы должны увидеть (при условии, что ваш ArtiftId равен beam-examples , а версия 1.0.0 ):

beam-examples-1.0.0 -заштрихованный .jar

Для работы с автономным кластером просто запустите:

Для запуска на основе RDD/DStream:

spark-submit --class com.beam.examples.BeamPipeline --master spark://HOST: ПОРТ target/beam-examples-1.0.0-shaded.jar --runner=SparkRunner

Для бегуна на основе Structured Streaming:

spark-submit --class com.beam.examples.BeamPipeline --master spark://HOST:PORT target/beam-examples-1.0.0-shaded.jar --runner=SparkStructuredStreamingRunner

Вам потребуется установить Docker в вашей среде выполнения. Развивать

Apache Beam с Python необходимо установить Apache Beam Python SDK: pip install apache_beam . Пожалуйста, обратитесь к документации Python

о том, как создать конвейер Python.

pip install apache_beam

Начиная с Beam 2.20.0, готовые образы Docker службы заданий Spark доступны по адресу

Докер Хаб.

Для более старых версий Beam вам потребуется копия исходного кода Apache Beam. Ты можешь

загрузите его на странице загрузок.

- Запустите конечную точку JobService:

- с помощью Docker (предпочтительно):

docker run --net=host apache/beam_spark_job_server:latest - или из исходного кода Beam:

. /gradlew :runners:spark:3: работа -сервер: запуститьShadow

/gradlew :runners:spark:3: работа -сервер: запуститьShadow

- с помощью Docker (предпочтительно):

JobService — это центральная инстанция, куда вы отправляете конвейер Beam.

JobService создаст задание Spark для конвейера и выполнит

работа. Чтобы выполнить задание в кластере Spark, Beam JobService должен быть

предоставляется с главным адресом Spark.

- Отправьте конвейер Python на указанную выше конечную точку, используя

PortableRunner,job_endpoint, установленный наlocalhost:8099(это адрес JobService по умолчанию) иenvironment_typeустановлен наLOOPBACK. Например:

импортировать apache_beam как луч

из apache_beam.options.pipeline_options импортировать PipelineOptions

options = PipelineOptions([

"--runner=PortableRunner",

"--job_endpoint=локальный:8099",

"--environment_type=LOOPBACK"

])

с beam.Pipeline(options) как p:

... Работа в предварительно развернутом кластере Spark

Развертывание конвейера Beam в кластере, в котором уже есть развертывание Spark (классы Spark доступны в пути к классам контейнера), не требует дополнительных зависимостей.

Дополнительные сведения о различных режимах развертывания см. в разделе: Standalone, YARN или Mesos.

- Запустите кластер Spark, который по умолчанию предоставляет мастер на порту 7077.

- Запустите JobService, который будет подключаться к мастеру Spark:

- с Docker (предпочтительно):

docker run --net=host apache/beam_spark_job_server:latest --spark-master-url=spark://localhost:7077 - или из исходного кода Beam:

./gradlew :runners:spark:3:job-server:runShadow -PsparkMasterUrl=spark://localhost:7077

- с Docker (предпочтительно):

- Отправьте конвейер, как указано выше.

Однако обратите внимание, чтоenvironment_type=LOOPBACKпредназначен только для локального тестирования.

Подробнее см. здесь.

(Обратите внимание, что в зависимости от конфигурации вашего кластера вам может потребоваться изменить параметр environment_type .

Подробнее см. здесь.)

Запуск в кластере Dataproc (с поддержкой YARN)

Для запуска заданий Beam, написанных на Python, Go и других поддерживаемых языках, можно использовать SparkRunner и PortableRunner 9. 0440, как описано на странице Beam Spark Runner (см. также дорожную карту Portability Framework).

0440, как описано на странице Beam Spark Runner (см. также дорожную карту Portability Framework).

В следующем примере выполняется переносимое задание Beam на Python из главного узла кластера Dataproc с поддержкой Yarn.

Примечание. Этот пример успешно выполняется с Dataproc 2.0, Spark 3.1.2 и Beam 2.37.0.

- Создайте кластер Dataproc с включенным компонентом Docker.

Кластеры gcloud dataproc создают CLUSTER_NAME \

--необязательные компоненты = ДОКЕР \

--image-version= DATAPROC_IMAGE_VERSION \

--region= РЕГИОН \

--enable-компонент-шлюз \

--scopes=https://www.googleapis.com/auth/cloud-platform \

--properties spark:spark.master.rest.enabled=true

-

--необязательные компоненты: Докер. -

--image-version: версия образа кластера, которая определяет версию Spark, установленную в кластере (например, см. версии компонентов Apache Spark, перечисленные для последней и предыдущих четырех версий выпуска образа 2.0.x).

версии компонентов Apache Spark, перечисленные для последней и предыдущих четырех версий выпуска образа 2.0.x). -

--region: поддерживаемый регион Dataproc. -

--enable-component-gateway: разрешить доступ к веб-интерфейсам. -

--scopes: включить доступ API к сервисам GCP в том же проекте. -

--properties: добавить конкретную конфигурацию для некоторого компонента, здесь spark.master.rest позволяет использовать отправку заданий в кластер.

- Создайте корзину облачного хранилища.

gsutil мб BUCKET_NAME

- Установите необходимые библиотеки Python для работы в вашей локальной среде.

python -m pip установить apache-beam [gcp] == BEAM_VERSION

- Объедините пример конвейера подсчета слов вместе со всеми зависимостями, артефактами и т. д., необходимыми для запуска конвейера, в банку, которую можно будет выполнить позже.

python -m apache_beam.examples.wordcount \

--runner=SparkRunner \

--output_executable_path= OUTPUT_JAR_PATH \

--output=gs:// BUCKET_NAME /python-wordcount-out \

--spark_version=3

-

--runner(обязательно):SparkRunner. -

--output_executable_path(обязательно): путь для создания jar пакета. -

--output(обязательно): куда записывается вывод. -

--spark_version(необязательно): выберите версию spark 3 (по умолчанию) или 2 (устарело!).

- Отправить искровое задание на главный узел кластера Dataproc.

Задания gcloud dataproc отправляют искру \

--cluster= ИМЯ_КЛАСТЕРА \

--region= РЕГИОН \

--class=org.apache.beam.runners.spark.SparkPipelineRunner \

--jars= OUTPUT_JAR_PATH

-

--cluster: имя созданного кластера Dataproc.

-

--region: поддерживаемый регион Dataproc. -

--class: точка входа для вашего приложения. -

--jars: путь к связанному банку, включая ваше приложение и все зависимости.

- Убедитесь, что результаты были записаны в корзину.

gsutil cat gs:// BUCKET_NAME /python-wordcount-out- SHARD_ID

Параметры конвейера для Spark Runner

При выполнении конвейера с помощью Spark Runner следует учитывать следующие параметры конвейера.

Для бегуна на основе RDD/DStream:

| Поле | Описание | Значение по умолчанию |

|---|---|---|

| Используемая направляющая трубопровода. Этот параметр позволяет определить исполнителя конвейера во время выполнения. | Установите значение SparkRunner для запуска с использованием Spark. | |

sparkMaster | URL-адрес Spark Master. Это эквивалент настройки SparkConf#setMaster(String) и может быть local[x] для локального запуска с x ядрами, spark://host:port для подключения к автономному кластеру Spark, mesos://host:port для подключения к кластеру Mesos или пряжа для подключения к кластеру пряжи. | local[4] |

storageLevel | StorageLevel для использования при кэшировании RDD в пакетных конвейерах. Spark Runner автоматически кэширует RDD, которые многократно оцениваются. Это свойство предназначено только для пакетов, поскольку потоковые конвейеры в Beam сохраняют состояние, для чего требуется Spark DStream 9.0439 StorageLevel должен быть MEMORY_ONLY . | MEMORY_ONLY |

batchIntervalMillis | StreamingContext s batchDuration — установка интервала пакетной обработки Spark. | 1000 |

enableSparkMetricSinks | Включить отправку метрик в приемники метрик Spark. | true |

cacheDisabled | Отключить кэширование повторно используемых PCollections для всего конвейера. Это полезно, когда быстрее пересчитать RDD, чем сохранить. | false |

Для исполнителя на основе структурированной потоковой передачи:

| Поле | Описание | По умолчанию Значение |

|---|---|---|

бегунок | Используемый бегун конвейера. Этот параметр позволяет определить исполнителя конвейера во время выполнения. | Установите значение SparkStructuredStreamingRunner для запуска с использованием Spark Structured Streaming. |

искрмастер | URL Spark Master. Это эквивалентно настройке SparkConf#setMaster(String) и может быть либо local[x] для локального запуска с x ядрами, либо spark://host:port для подключения к автономному кластеру Spark, либо mesos. для подключения к кластеру Mesos или yarn для подключения к кластеру yarn. | локальный[4] |

testMode | Включить тестовый режим, который предоставляет полезную отладочную информацию: планы выполнения катализатора и печать Beam DAG | false |

enableSparkMetricSinks | Включить отправку метрик в Spark Sinks Sinks. | true |

checkpointDir | Каталог контрольной точки для устойчивости потоковой передачи, игнорируемый в пакетном режиме. Для долговечности необходима надежная файловая система, такая как HDFS/S3/GS. | локальный каталог в /tmp |

filesToStage | Jar-файлы для отправки всем рабочим процессам и размещения в classpath. | все файлы из пути к классам |

EnableSparkMetricSinks | Включить/отключить отправку значений агрегатора в приемники метрик Spark | true |

| Поле | Описание | Значение |

|---|---|---|

--бегун | Используемая направляющая трубопровода. Этот параметр позволяет определить исполнителя конвейера во время выполнения. Этот параметр позволяет определить исполнителя конвейера во время выполнения. | Установите PortableRunner для запуска с использованием Spark. |

--job_endpoint | Конечная точка службы заданий для использования. Должен быть в форме hostname:port, например. localhost:3000 | Установите в соответствии с конечной точкой службы заданий (localhost:8099 по умолчанию) |

Дополнительные примечания

Использование spark-submit

При отправке приложения Spark в кластер обычно (и рекомендуется) использовать сценарий spark-submit , который поставляется вместе с установкой spark.

PipelineOptions , описанный выше, не заменяет spark-submit , а дополняет его.

Передача любой из вышеупомянутых опций может быть выполнена как один из аргументов приложения , и установка –master имеет приоритет.

Дополнительные сведения о том, как обычно использовать spark-submit check, см. в документации Spark.

в документации Spark.

Мониторинг задания

Вы можете отслеживать выполнение задания Spark с помощью веб-интерфейсов Spark. По умолчанию это доступно на порту 4040 на узле драйвера. Если вы запустите Spark на своем локальном компьютере, это будет http://localhost:4040 .

Spark также имеет сервер истории для просмотра постфактум.

Метрики также доступны через REST API.

Spark предоставляет систему метрик, которая позволяет сообщать метрики Spark различным приемникам.

Средство Spark runner сообщает об определяемых пользователем агрегаторах лучей с использованием той же системы метрик и в настоящее время поддерживает

ГрафитРаковина

и CSVSink.

Обеспечить поддержку дополнительных приемников, поддерживаемых Spark, легко и просто.

Метрики Spark еще не поддерживаются на портативном устройстве выполнения.

Потоковое выполнение

Для исполнителя на основе RDD/DStream:

Если в конвейере используется UnboundedSource , Spark Runner автоматически установит режим потоковой передачи. Принудительный режим потоковой передачи в основном используется для тестирования и не рекомендуется.

Принудительный режим потоковой передачи в основном используется для тестирования и не рекомендуется.

Для средства выполнения на основе структурированной потоковой передачи:

Режим потоковой передачи еще не реализован в средстве выполнения структурированной потоковой передачи Spark.

Потоковая передача пока не поддерживается на портативном бегунке Spark.

Использование предоставленного SparkContext и StreamingListeners

Для исполнителя на основе RDD/DStream:

Если вы хотите выполнить задание Spark с предоставленным SparkContext , например, при использовании spark-jobserver, или используйте 9043 9 прослушивателей потокового вещания , вы не можете использовать SparkPipelineOptions (в любом случае контекст или прослушиватель не могут быть переданы в качестве аргумента командной строки).

Вместо этого вы должны использовать SparkContextOptions , который может использоваться только программно и не является обычной реализацией PipelineOptions .

://host:port

://host:port